El mundo de la generación 3D vuelve a dar un salto con Trellis 2, un modelo open‑source de 4 mil millones de parámetros para convertir una imagen en un objeto 3D con materiales PBR de alta fidelidad.

Qué es trellis 2 y qué lo hace diferente

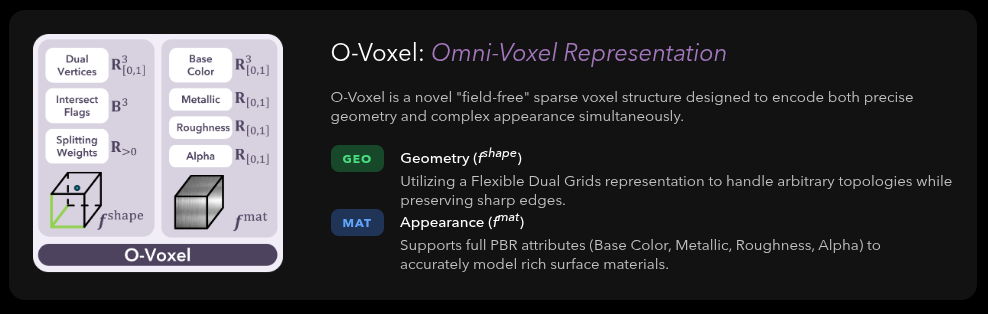

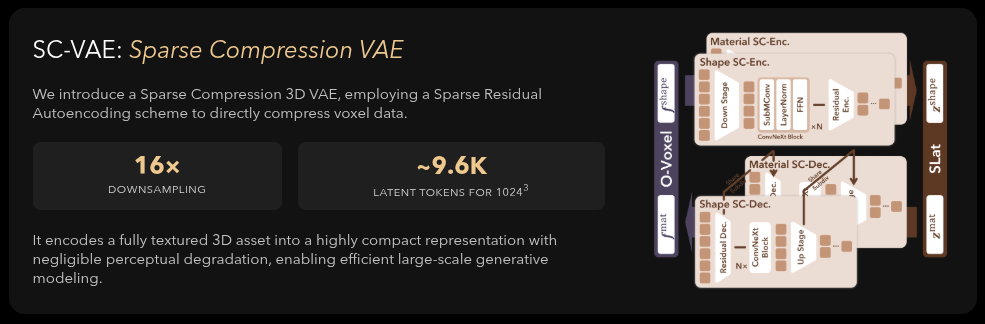

Trellis 2 es un modelo generativo de imagen‑a‑3D que utiliza una estructura de voxeles esparcidos denominada O‑Voxel y un transformador de flujo de 4 B parámetros. A diferencia de métodos basados en campos iso‑superficie, puede reconstruir y generar activos tridimensionales complejos con superficies abiertas, geometrías no manifold e incluso interiores enclaustrados. La compactación de datos es otra clave: un VAE (Variational Autoencoder) de compresión dispersa reduce el espacio latente a tan solo 9 600 tokens para un volumen de 1024³, con 16× de reducción espacial.

El modelo genera activos totalmente texturizados a resoluciones de 512³, 1024³ y 1536³ vóxeles en tiempos aproximados de 3, 17 y 60 segundos respectivamente en una GPU NVIDIA H100. La eficiencia no sacrifica calidad: las texturas incluyen color base, rugosidad, metalicidad y opacidad para renderizado físicamente realista.

Principales características

-

Representación O‑Voxel: una estructura de voxeles de tipo “field‑free” que codifica geometría y apariencia simultáneamente. Soporta superficies abiertas, geometrías no manifold e interiores cerrados.

-

Compresión eficiente: el SC‑VAE (Sparse Compression Variational Autoencoder) comprime los datos 3D con 16× de reducción espacial y ~9,6k tokens latentes, permitiendo entrenar un modelo de 4 B parámetros y generar en alta resolución.

-

Rica representación material: además de la geometría, se conservan atributos de PBR como color base, rugosidad, metalicidad y canal alfa.

-

Procesamiento rápido: la conversión entre malla texturizada y O‑Voxel toma menos de 10 s en CPU y menos de 100 ms en GPU CUDA.

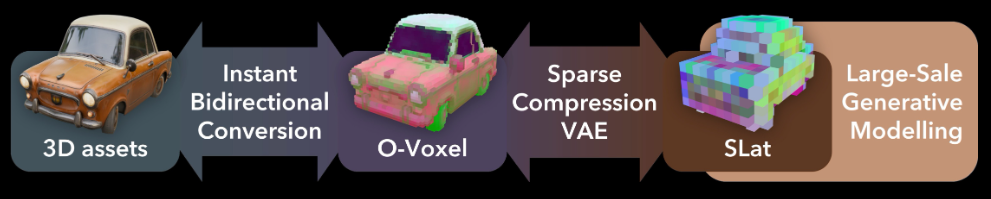

Pipeline y arquitectura

Trellis 2 comienza con una conversión bidireccional instantánea que transforma una malla texturizada en un O‑Voxel. Después, un VAE de compresión dispersa codifica los voxeles en un espacio latente compacto. En la etapa de generación, un transformador de flujo produce un nuevo O‑Voxel desde el latente y se reconvierte a malla texturizada en milisegundos. La combinación de SC‑VAE y O‑Voxel permite modelar estructuras arbitrarias con un procesamiento eficiente.

Requisitos y compatibilidad

Para ejecutar Trellis 2 se necesita un entorno Linux con Python ≥ 3.8, CUDA Toolkit 12.4 (o similar) y se recomienda usar Conda para gestionar dependencias. En cuanto a hardware, hace falta una GPU NVIDIA con al menos 24 GB de memoria. El código se ha verificado en tarjetas A100 y H100. Por tanto, en máquinas domésticas con menos VRAM no se podrá generar en resoluciones altas.

Cómo sacar partido a trellis 2

-

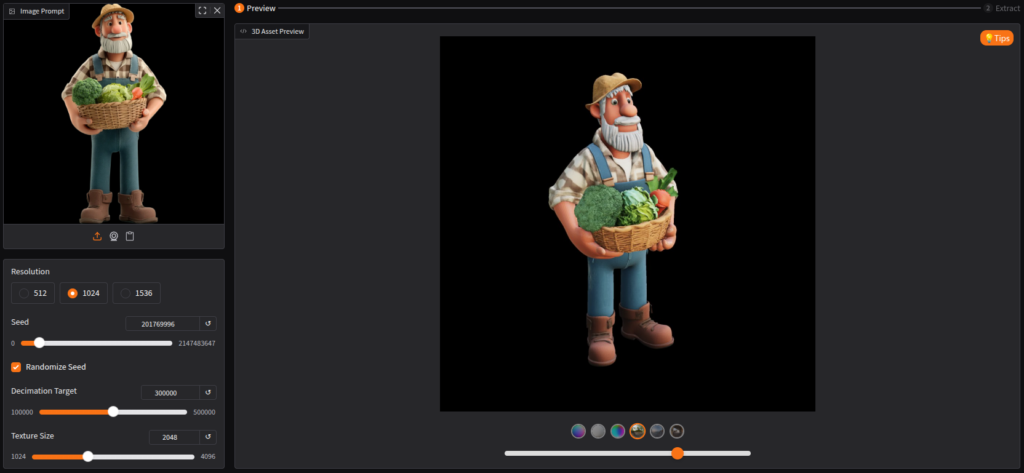

Empieza con una demo web. Antes de instalar nada, prueba el modelo en un Space de Hugging Face o en una demo en línea, es la manera más sencilla de ver los resultados sin consumir recursos propios. Algunos espacios oficiales proporcionan interfaces donde subes una foto y descargas un archivo GLB listo para usar.

-

Prepara bien la imagen de entrada. La calidad del 3D depende directamente de la fotografía. Usa imágenes con el sujeto centrado, buena iluminación, fondo neutro y resolución mínima de 512×512 píxeles. Evita fondos con ruido, perspectivas extremas o objetos superpuestos.

-

Ajusta las guías de generación. El proceso consta de dos etapas: generación de estructura dispersa y generación latente estructurada. El parámetro

ss_guidance_strengthcontrola cuánto sigue la estructura inicial a la imagen; valores altos (7‑9) respetan más la forma. El parámetroslat_guidance_strengthrefina detalles; no conviene subirlo mucho para evitar artefactos. -

Controla los pasos de muestreo. Por defecto se usan 12 pasos en cada etapa; aumentar a 16‑20 mejora estructuras complejas pero alarga el tiempo.

-

Simplifica la malla cuando convenga. El parámetro

mesh_simplify(0,95 por defecto) reduce polígonos en la malla final. Valores más bajos agilizan el uso en tiempo real (p. ej., 0,85 para móviles). -

Elige la resolución de textura adecuada. Puedes generar texturas de 512, 1024 o 2048 píxeles. Para vistas preliminares basta con 512; para producción, opta por 1024 o 2048.

-

Maximiza la VRAM disponible. Si instalas el modelo localmente, exporta variables de entorno como

PYTORCH_CUDA_ALLOC_CONF=expandable_segments:TrueyOPENCV_IO_ENABLE_OPENEXR=1(tal y como indica el ejemplo de uso de Hugging Face) para aprovechar mejor la memoria de la GPU. -

Corrige pequeños artefactos. Las mallas crudas pueden contener pequeños agujeros o discontinuidades. Si necesitas geometrías herméticas (por ejemplo para impresión 3D), aplica post‑procesados de relleno de agujeros o simplificación de malla.

Posibles aplicaciones y limitaciones

Gracias a su capacidad para generar activos 3D ricos en materiales y en cuestión de segundos, Trellis 2 es ideal para videojuegos, realidad virtual, visualización de productos y prototipado rápido. Los activos se exportan en formato GLB y pueden importarse directamente en motores como Unity, Unreal Engine o Blender.

No obstante, hay que tener en cuenta ciertas limitaciones. La versión liberada no está alineada con preferencias humanas y su estilo depende del conjunto de entrenamiento. Además, los datasets podrían contener sesgos. Microsoft recuerda que el modelo es un proyecto de investigación y se revisó para evitar datos personales.

En definitiva, Trellis 2 marca un hito en la generación 3D al combinar un espacio latente compacto y eficiente con un modelo de gran escala. Su capacidad para reconstruir geometrías complejas y texturas físicas de alta calidad en pocos segundos abre la puerta a aplicaciones creativas y productivas. Con los tips anteriores podrás sacarle el máximo provecho, ya sea desde un Space en la nube o montando el modelo en una GPU profesional. En cualquier caso, este avance es un paso más hacia un futuro donde la inteligencia artificial genera mundos completos con la misma facilidad con la que ahora generamos imágenes.

Si este tipo de avances en generación 3D, modelos latentes y sistemas capaces de entender el mundo en tres dimensiones encajan con lo que estás construyendo, en The Black Box Lab estaremos encantados de escucharte y explorar juntos hasta dónde puede llegar la tecnología.

Deja una respuesta